LM StudioでローカルLLMはじめる

ローカルLLMってなに?と思われると思います。

簡単にいうと自分のPCの中にChat-GPTのような仕組みを作ってしまうことです。

LLMは、日本語で「大規模言語モデル」と呼ばれています。

ローカルLLMは、Meta社が開発したllama・・・

説明がヘタなのでインターネットで検索してみてください。もっと精通している方々がわかりやすい図で開設してくれていると思います。

じゃあ、早速ローカルLLMで自分用のAIを手に入れるところからはじめます。

手っ取り早く動かすときに適したアプリがあります。それが「LM Studio」です。

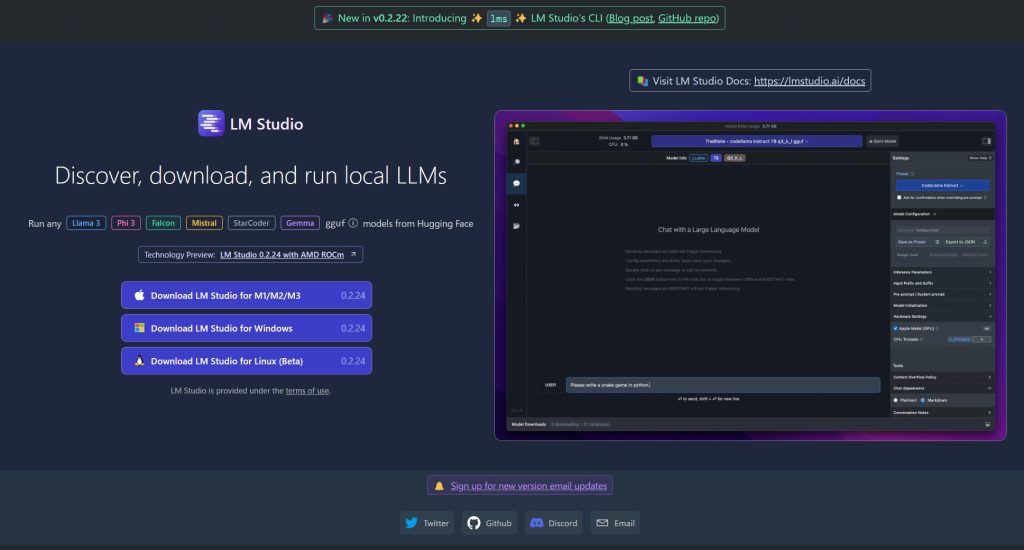

LM Studio ダウンロードリンク-> https://lmstudio.ai/

1). こんなページが表示されるのでWindowsの方は、Download LM Studio for WIndowsをクリックしてダウンロードとインストールをしてみてください。

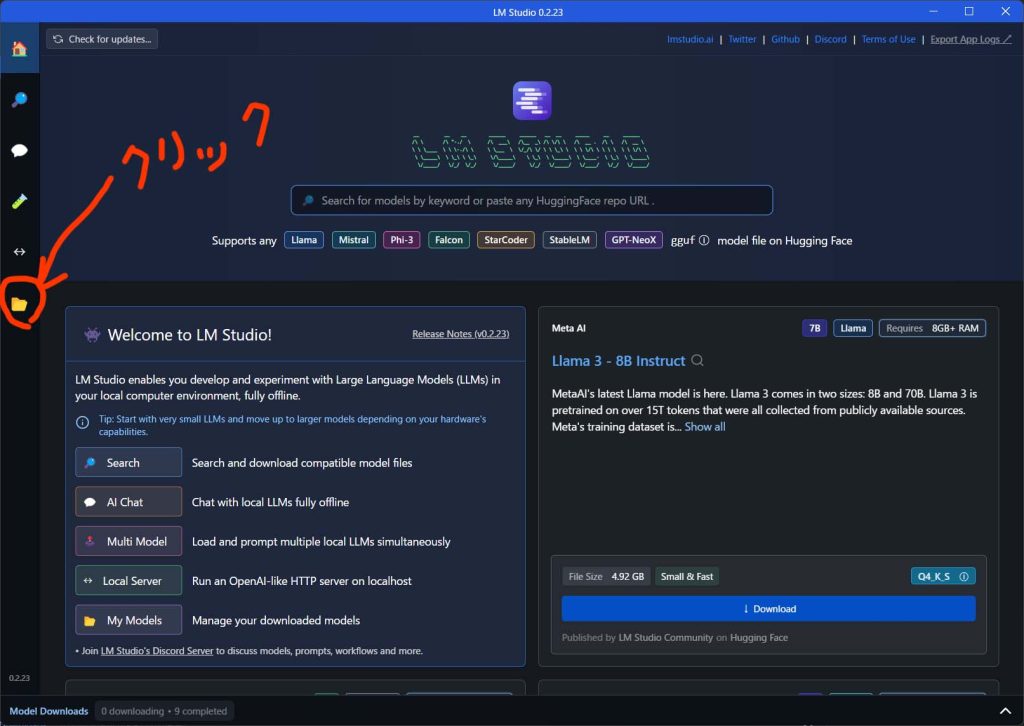

2). 起動するとこんな画面が出てきます。左側がツールバーになっています。LLMファイルは1つ8GBほどありますので、Cドライブの空きが心配な方はフォルダマークのツールをクリックしてください。そんなの関係ねえと思われる方は4)に進んでください

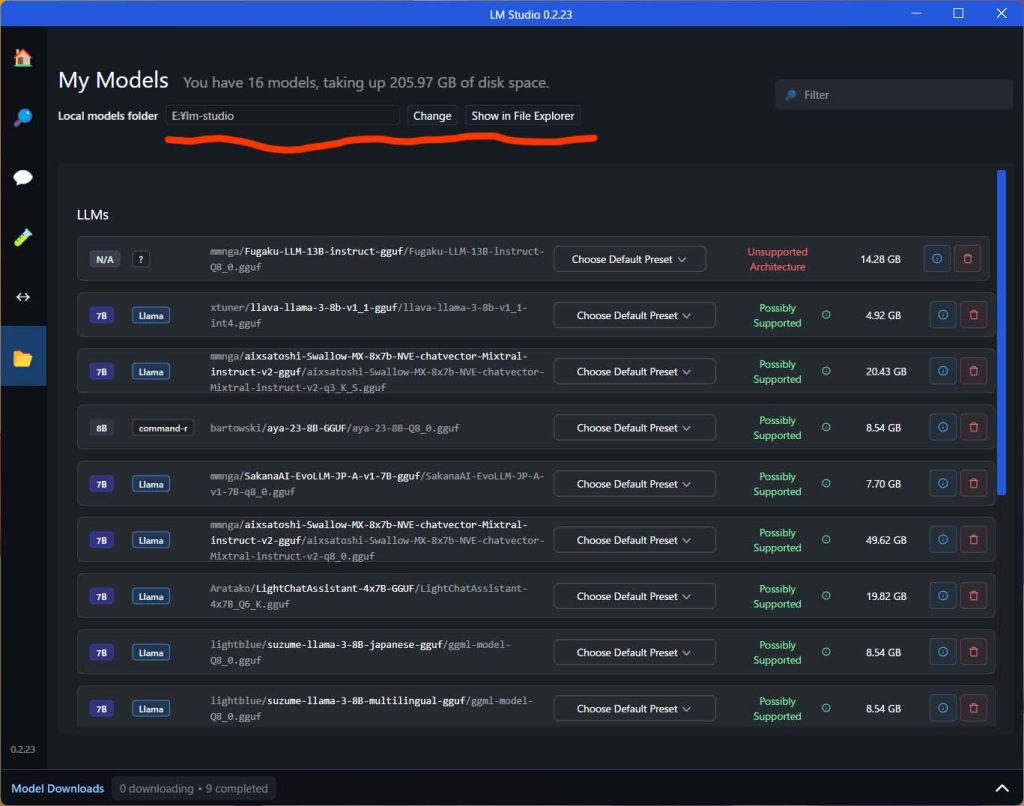

3). 赤線のCHangeボタンを押して空のあるドライブに「LM Studio」などのフォルダを作ってそれを指定してください。

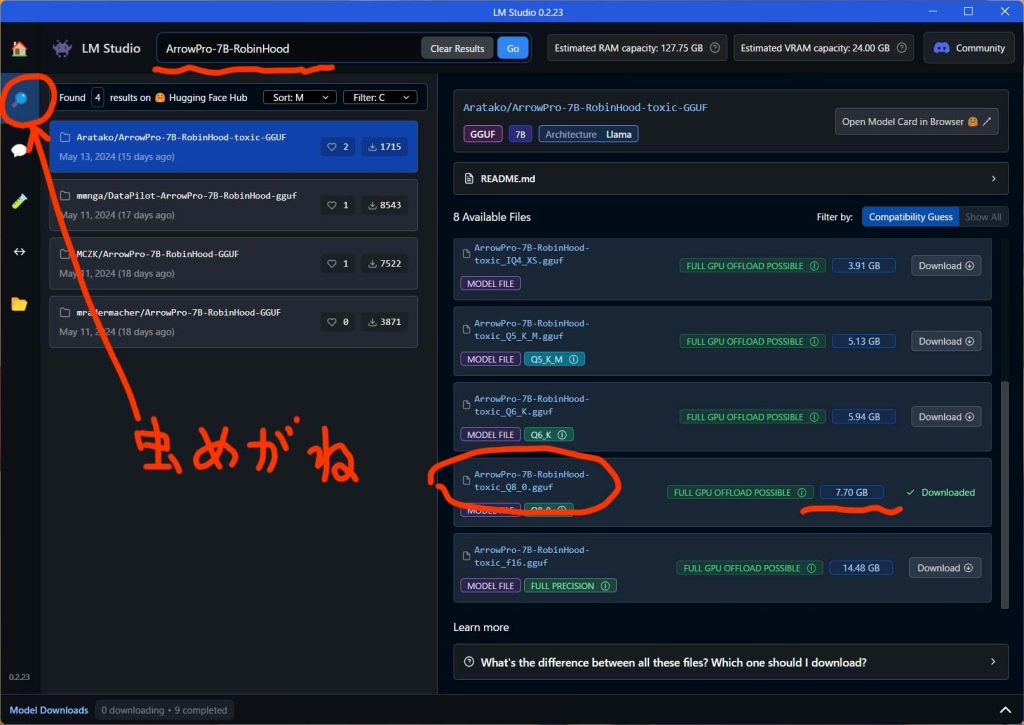

4). 次はLLMファイルをダウンロードします。左側のツールの中の虫眼鏡をクリックして検索画面を表示します。

赤線の部分にLLMファイルの名前を入力して「Go」を押すと左画面と右画面に検索結果が表示されます。

LLMファイルの名前に何を入力すればよいか?まずは「ArrowPro-7B-RobinHood」と入力して検索しましょう。

日本語LLMで「FUGAKU」や「ELYZA」が有名ですが、それはまた違う用途のときに使用します。

ArrowPro-7B-RobinHoodは、チャットの返答が早くエッチな話題もOKです。FUGAKUでエッチな話をすると叱られますので

ちゃんとした調べものとかに使用します。

ArrowPro-7B-RobinHoodが見つかったら右画面のDownloadボタンを押してダンロードを始めます。

ファイル名にQ6やQ8、f16などの文字が入っています。f16が一番ファイルサイズが大きいのがわかります。

サイズがデカければよいというわけではなさそうです。結論から申し上げるとQ8がよさそうです。

なんでQ8がいいのか?Baku様がわかりやすく説明してくださってるのでそちらを参照してください。->ローカルLLM自由帳

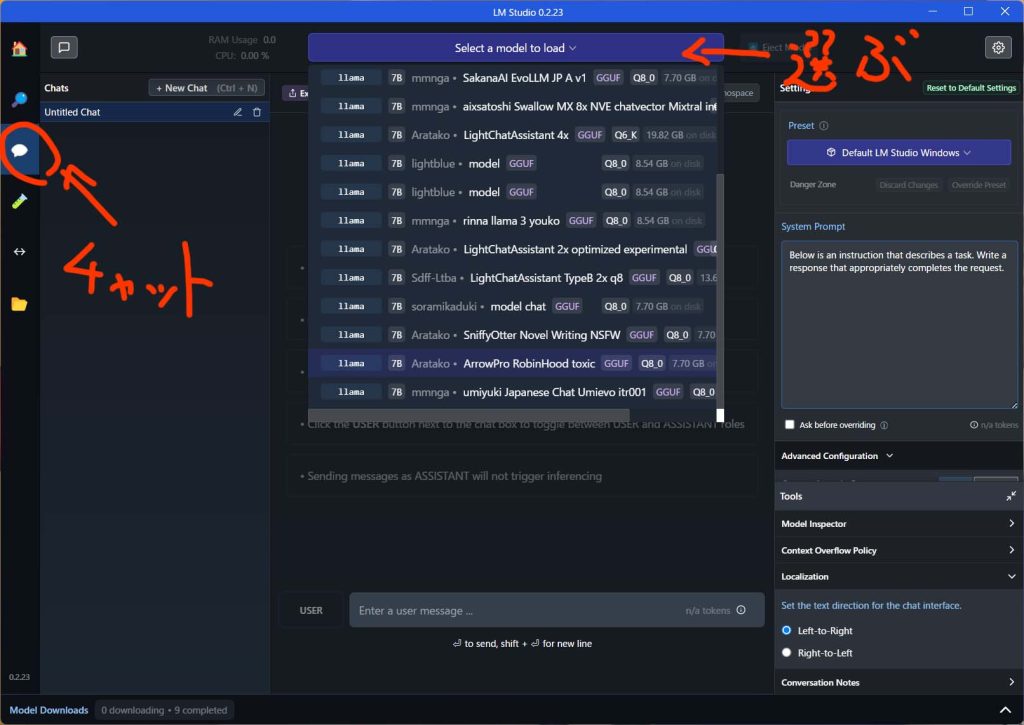

5). ダウンロードが完了したら、早速チャットを開始します。左側のツールの吹き出しマークをクリックしてチャット画面を表示します。

中央上の「Select model to load」をクリックすると先ほどダウンロードしたダウンロードしたファイルが出てきますので選びます。

ロードが完了するとチャットが開始できます。

なんて簡単なんだ・・・これであなたのPCにAIが宿ります。

ひとつ注意することはnVidiaのグラフィックカードを搭載していないPCは、動作が遅くて厳しいと思います。

できれば、Geforce RTX 3060 12GB 、メインメモリは32GBはあった方がいいです。

グラフィックカードのメモリは、8GBは少々厳しいかもしれません。

まあ、遅くても動くのでそこは、ご予算とご相談してください。

6). さて早速、ちょっとエッチな美少女とチャットを開始です。

おい・・・